Qué es un agente de IA y por qué importa entenderlo

¿Por qué algunas herramientas de IA solo contestan preguntas y otras ya pueden buscar datos, llamar APIs, coordinar pasos y devolver un resultado casi terminado? Esa diferencia no es menor: separa a un simple sistema conversacional de uno capaz de actuar con cierto margen de autonomía.

Entender qué es un agente de IA importa ahora porque el término se volvió central en productos, plataformas cloud y software empresarial. Según la definición actualizada de Google Cloud, publicada el 12/04/2025, estos sistemas persiguen objetivos, planifican, usan memoria y ejecutan tareas en nombre del usuario. La idea, por tanto, ya no se limita a “responder bien”, sino a resolver.

Tabla de contenidos

- Qué es un agente de IA exactamente

- Cómo funciona un agente de IA en la práctica

- Diferencias entre agente, asistente y bot

- Tipos de agentes de IA más comunes

- Dónde se están usando hoy

- Beneficios, límites y riesgos reales

- Qué conviene evaluar antes de implementarlo

- Preguntas frecuentes sobre qué es un agente de IA

Qué es un agente de IA exactamente

Un agente de IA es un sistema de software que recibe un objetivo, analiza el contexto, decide qué pasos seguir y utiliza recursos disponibles para completar una tarea con un nivel de autonomía mayor que el de un chatbot convencional.

Esa es la respuesta corta, y conviene retenerla porque resume la diferencia esencial. Según IBM, un agente puede razonar paso a paso, usar herramientas externas y reajustar su plan si el entorno cambia. No siempre “piensa” como un humano, pero sí encadena acciones para acercarse a una meta.

Lo importante es que no vive aislado dentro del modelo. Un agente puede consultar una base de datos, leer un calendario, revisar inventario, invocar otra aplicación o pedir validación humana antes de ejecutar algo sensible. Ahí aparece su valor real: conecta la capacidad de lenguaje con la acción operativa.

Cómo funciona un agente de IA en la práctica

Los datos disponibles indican que la mayoría de agentes modernos comparten un ciclo básico: reciben una instrucción, la convierten en subtareas, consultan herramientas y evalúan si el resultado cumple el objetivo. Ese flujo puede durar segundos o varios turnos, según la complejidad.

Objetivo, contexto y reglas

Todo empieza con tres piezas: una meta, un contexto y unos límites. La meta puede ser “resumir incidencias de soporte”, “proponer una ruta logística” o “redactar un correo con datos actualizados”. El contexto aporta información del entorno, mientras que las reglas fijan qué sí puede hacer y qué no.

Sin esa base, el sistema improvisa demasiado. Con ella, en cambio, puede priorizar acciones, decidir cuándo necesita más datos y detectar cuándo debe escalar a una persona.

Herramientas, memoria y ejecución

Expertos en el área coinciden en que la diferencia práctica la marcan las herramientas y la memoria. Un modelo sin acceso externo responde con lo que sabe; un agente puede consultar fuentes en tiempo real, guardar estados intermedios y retomar una tarea sin empezar de cero.

Por eso se habla tanto de planificación, observación y ejecución. Primero interpreta el encargo. Luego actúa sobre el entorno digital. Después revisa el resultado y corrige si hace falta. Esa secuencia explica por qué un agente puede reservar una reunión, clasificar tickets o preparar un informe en varios pasos.

Diferencias entre agente, asistente y bot

Aquí suele aparecer la mayor confusión. No todo sistema que conversa es un agente, y no todo agente tiene que verse como un chat.

| Sistema | Qué hace mejor | Nivel de autonomía | Ejemplo típico |

|---|---|---|---|

| Bot | Respuestas o flujos predefinidos | Bajo | FAQ automática con reglas |

| Asistente de IA | Ayuda al usuario dentro de una interfaz | Medio | Copiloto que sugiere texto o acciones |

| Agente de IA | Persigue objetivos y ejecuta varios pasos | Medio o alto | Sistema que consulta datos, decide y actúa |

Un bot clásico responde a comandos o rutas cerradas. Un asistente suele colaborar de forma reactiva: espera tu instrucción y te acompaña. El agente, en cambio, puede tomar la iniciativa dentro de un marco definido, elegir herramientas y completar partes del trabajo.

Según Google Cloud, la autonomía y la capacidad de manejar tareas complejas son las diferencias más claras entre agentes, asistentes y bots. Esa distinción ayuda a no sobreprometer. Si una solución solo responde preguntas frecuentes, llamarla “agente” puede ser más marketing que arquitectura.

Tipos de agentes de IA más comunes

La evidencia apunta a que no existe un único tipo de agente. De hecho, el concepto mezcla ideas clásicas de la inteligencia artificial con desarrollos recientes basados en modelos fundacionales.

Una clasificación útil incluye estos grupos:

- Agentes reactivos, que responden a condiciones inmediatas.

- Agentes basados en objetivos, que planifican acciones para llegar a una meta.

- Agentes basados en utilidad, que comparan opciones y eligen la más conveniente según criterios definidos.

- Agentes con aprendizaje, que ajustan su desempeño con retroalimentación.

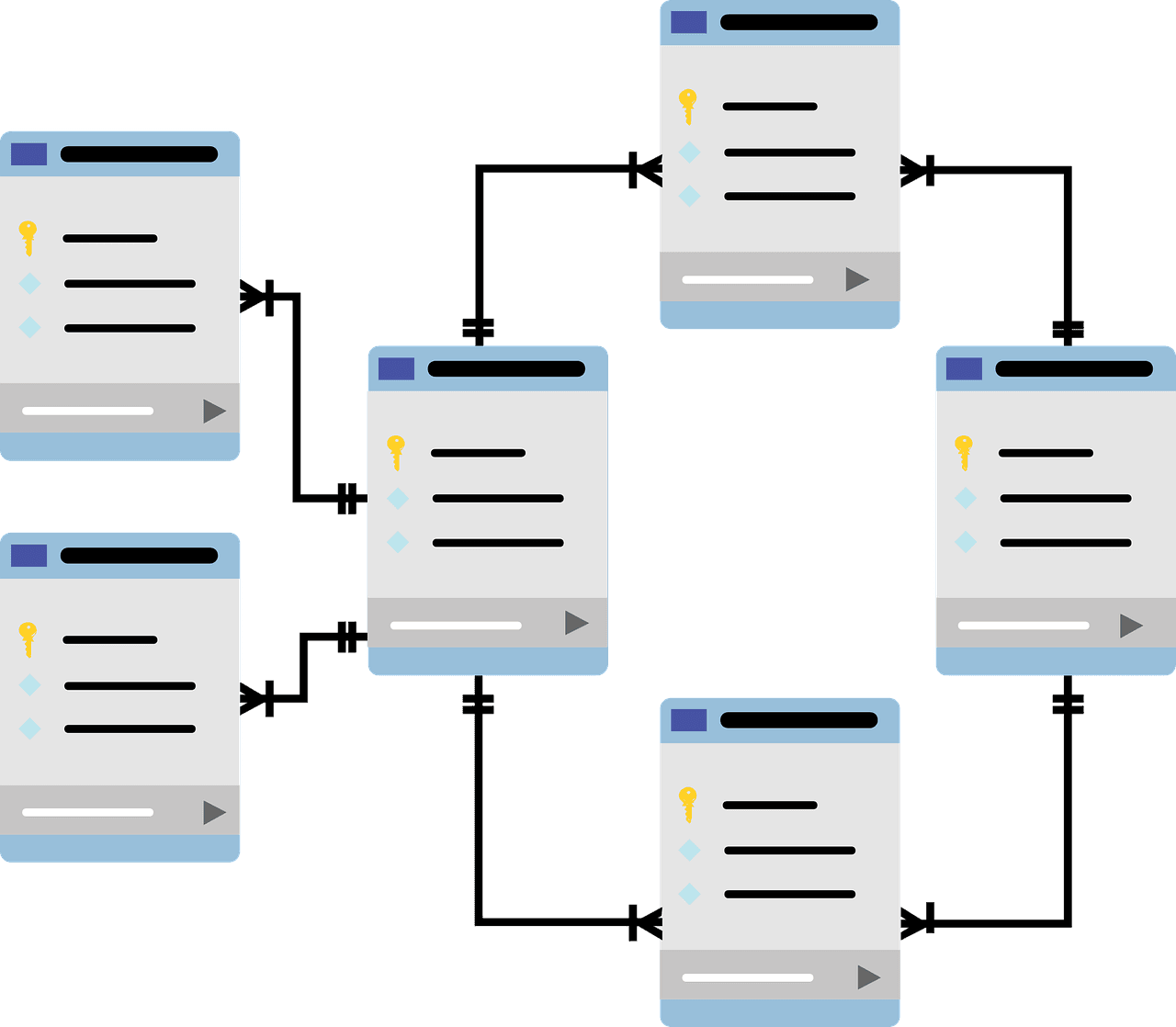

- Sistemas multiagente, donde varios agentes colaboran o se reparten funciones.

Los modelos actuales suelen combinar varias de estas lógicas. Por ejemplo, un agente de atención al cliente puede reaccionar a una consulta, planificar la búsqueda de datos, valorar varias respuestas y pedir aprobación humana si detecta un caso delicado. Esa mezcla explica por qué el término se ha vuelto tan amplio.

Dónde se están usando hoy

Más allá de la teoría, los agentes ya aparecen en procesos concretos. IBM y Google Cloud coinciden en usos recurrentes: soporte al cliente, desarrollo de software, operaciones de TI, análisis de datos, marketing, seguridad y flujos internos de productividad.

En atención al cliente, un agente puede revisar el historial, consultar el estado de un pedido y redactar una respuesta contextual. En desarrollo, puede inspeccionar repositorios, proponer cambios y ejecutar pasos controlados. En análisis, cruza datos, genera hipótesis y prepara un primer informe.

Aquí conviene repetir la idea central: qué es un agente de IA no se entiende del todo hasta verlo actuar sobre herramientas reales. La promesa no está solo en conversar mejor, sino en reducir fricción entre una intención humana y una tarea terminada.

Eso sí, cuanto más impacto tenga la acción, mayor debe ser la supervisión. Un agente que resume documentos no exige el mismo control que uno que aprueba pagos, modifica permisos o interactúa con sistemas críticos.

Beneficios, límites y riesgos reales

El atractivo principal está en la productividad. Un agente puede encargarse de tareas repetitivas, coordinar varios pasos y mantener consistencia operativa. Estudios y documentos recientes del sector muestran que esta arquitectura resulta especialmente útil cuando un proceso combina lenguaje, decisiones y acceso a herramientas externas.

Pero sería un error pensar que siempre conviene usar uno. Los límites siguen siendo importantes: pueden fallar al interpretar contexto ambiguo, entrar en bucles, usar mal una herramienta o ejecutar una acción correcta desde lo técnico pero errónea desde el negocio. Por eso entender este tipo de sistema también implica entender dónde no debe operar solo.

Además, hay riesgos de seguridad, privacidad y trazabilidad. El NIST insiste en una aproximación basada en riesgos para el diseño, uso y gobernanza de sistemas de IA. En el caso de los agentes, esa recomendación es todavía más relevante porque no solo generan texto: también actúan.

Qué conviene evaluar antes de implementarlo

El problema no suele ser “si la IA funciona”, sino si el agente encaja de verdad con el proceso. Antes de implementarlo, conviene revisar cinco puntos:

- El objetivo debe ser claro y medible.

- Las herramientas disponibles tienen que ser seguras y confiables.

- Debe existir trazabilidad de decisiones y acciones.

- Las tareas de alto impacto necesitan aprobación humana.

- Hay que evaluar coste, velocidad y beneficio real frente a una automatización más simple.

Estudios recientes muestran que muchas organizaciones obtienen mejores resultados cuando empiezan con procesos acotados: clasificación de casos, búsqueda documental, soporte interno o generación de borradores. Escalar después es más sensato que intentar un sistema omnipotente desde el día uno.

En otras palabras, la pregunta útil no es solo “si necesito IA”, sino “si necesito agencia”. A veces basta un asistente. Otras veces, un flujo tradicional con reglas. Elegir bien ahorra dinero, reduce riesgo y evita frustraciones.

Preguntas frecuentes sobre qué es un agente de IA

¿Un agente de IA es lo mismo que un chatbot? No. Un chatbot puede limitarse a responder mensajes siguiendo reglas o usando un modelo conversacional. Un agente añade capacidad de planificar, usar herramientas, consultar datos y ejecutar acciones. La diferencia clave está en esa posibilidad de actuar sobre un objetivo, no solo de conversar.

¿Qué ventajas ofrece un agente de IA frente a otras automatizaciones? Su ventaja aparece cuando una tarea no sigue siempre el mismo camino. Un flujo rígido funciona bien si todo está previsto; un agente puede adaptarse mejor, decidir qué paso dar y pedir información adicional. Por eso su valor se relaciona tanto con autonomía controlada, uso de contexto y resolución de tareas multietapa.

¿Puede un agente de IA trabajar sin supervisión humana? Puede hacerlo en tareas acotadas y de bajo riesgo, pero no debería operar sin control en procesos sensibles. La práctica más responsable es combinar autonomía con revisión humana, registros y límites claros. Su valor aumenta cuando existen guardrails, permisos y criterios de intervención.

¿Qué sectores están adoptando antes los agentes de IA? Los más visibles son atención al cliente, software, ciberseguridad, operaciones internas, análisis de datos y comercio electrónico. Son áreas donde hay muchos pasos digitales, datos dispersos y decisiones repetitivas. Ahí, comprender cómo opera un agente ayuda a detectar si se necesita una herramienta que asista o una que realmente ejecute partes del proceso.

¿Vale la pena para una pyme implementar agentes de IA? Depende del caso de uso. Si el problema es simple y repetitivo, quizá baste un bot o una automatización clásica. Si hay varias fuentes de datos, excepciones frecuentes y necesidad de respuesta rápida, puede tener sentido. La decisión correcta no empieza por seguir una moda, sino por definir bien el alcance del sistema y qué retorno concreto puede aportar.

La conversación sobre agentes seguirá creciendo porque representa un cambio práctico: pasar de pedir respuestas a delegar tareas delimitadas. Ese cambio puede elevar la productividad, pero también obliga a diseñar mejor procesos, permisos y controles.

Conviene quedarse con tres ideas. La primera: un agente no es solo un modelo que escribe bien, sino un sistema que combina objetivo, contexto, herramientas y capacidad de ejecución. La segunda: no toda empresa necesita el mismo grado de autonomía. La tercera: cuanto mayor es el impacto de la acción, mayor debe ser la gobernanza.

Si estás evaluando soluciones para tu equipo, revisa un proceso concreto que hoy consuma tiempo, tenga varios pasos digitales y requiera criterio repetible. Ese es el mejor terreno para probar con foco realista. La idea deja de ser teórica cuando puedes medir ahorro, calidad y riesgo en una tarea específica.